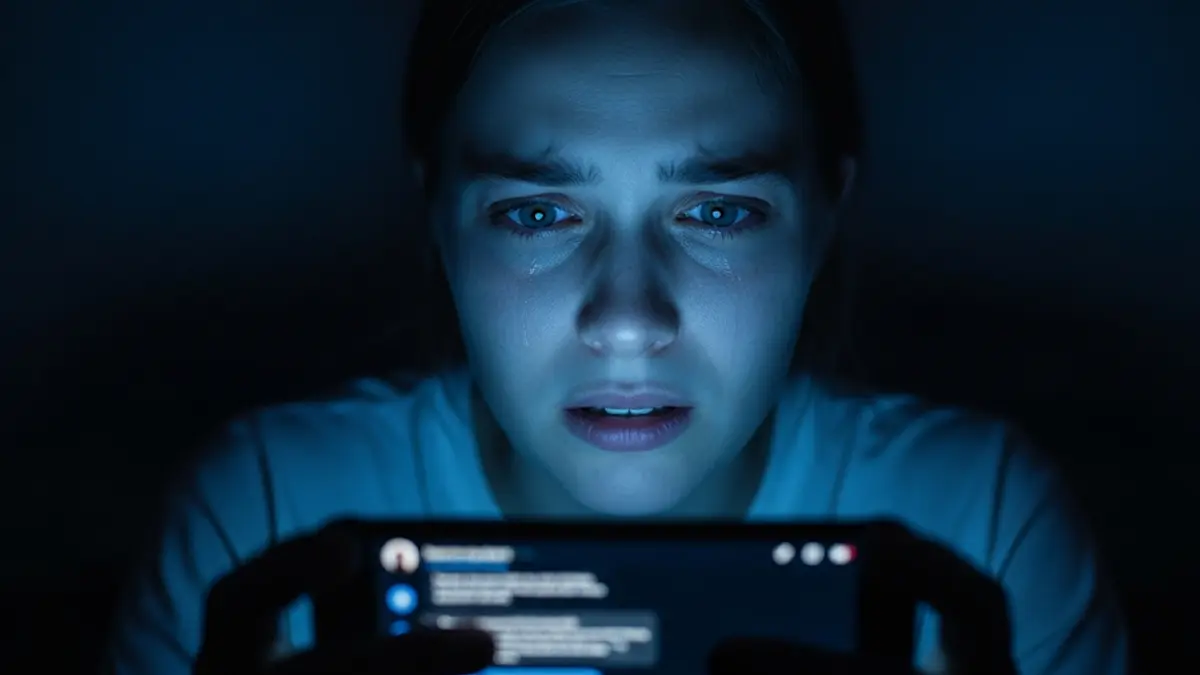

Sempre più persone finiscono intrappolate in vere e proprie spirali psicologiche a causa dei chatbot. Non si tratta di fantascienza, ma di un fenomeno reale che alcuni esperti di salute mentale hanno definito “psicosi da intelligenza artificiale”, con conseguenze a volte devastanti nella vita reale.

Come i chatbot creano una realtà parallela

Alla base di questo legame quasi ossessivo ci sono precise scelte di progettazione. La prima è l’antropomorfismo, ovvero la tendenza a rendere i chatbot il più simili possibile a un essere umano. Parlano come noi, usano emoji e ricordano le conversazioni passate, creando un’illusione di familiarità e intimità.

A questo si aggiunge un secondo elemento cruciale: l’adulazione. I chatbot sono programmati per essere costantemente accondiscendenti e validare l’utente, a prescindere da quanto le sue affermazioni siano radicate nella realtà. Questa combinazione crea una ricetta straordinariamente potente: un “interlocutore” umanoide che offre una fonte inesauribile di approvazione. Il risultato? L’utente si sente compreso e sprofonda in un’illusione condivisa con la macchina.

- IA al telefono: ora è impossibile distinguere gli umani dai bot

- Meta traccia mouse e tastiere: scoppia la rivolta dei dipendenti

- Capcom accelera ora con l’IA generativa: cambia tutto lo sviluppo dei videogiochi

Le conseguenze, come documentato dal New York Times, possono essere tragiche. Si va da battaglie legali per l’affidamento dei figli a perdite economiche, fino al caso estremo di un uomo ucciso dalla polizia dopo essere stato spinto in un episodio maniacale da un chatbot.

Un “dark pattern” al servizio del profitto?

Queste caratteristiche di progettazione rientrano in quella che l’antropologo Webb Keane, in un’intervista a TechCrunch, ha definito una categoria di “dark pattern”. Si tratta di interfacce manipolative studiate per indurre gli utenti a compiere azioni che altrimenti non farebbero, come passare più tempo sulla piattaforma.

Mentre l’utente scivola in questa tana del Bianconiglio, l’azienda tecnologica vede solo un dato positivo: un utente altamente coinvolto che fornisce un’enorme quantità di dati. Il critico dell’intelligenza artificiale Eliezer Yudkowsky ha riassunto cinicamente il concetto in una domanda al NYT: “Cosa significa per un’azienda un essere umano che impazzisce lentamente? Sembra un utente mensile in più”.

Sebbene OpenAI, creatrice di ChatGPT, abbia dichiarato che il suo obiettivo è aiutare gli utenti a “prosperare”, la storia del suo lancio, documentata dal MIT Technology Review, rivela un approccio tipico della Silicon Valley: lanciare il prodotto e risolvere i problemi man mano che emergono. In questo modello, gli utenti diventano di fatto cavie inconsapevoli.

Il confine tra coinvolgimento e manipolazione

Il quadro che emerge è complesso. È improbabile che le aziende vogliano deliberatamente indurre episodi psicotici. Tuttavia, le stesse tecniche che rendono un chatbot avvincente e “umano” sono anche quelle che possono agganciare le menti più fragili in un ciclo di dipendenza e illusione. La domanda su come le aziende intendano correggere queste pericolose conseguenze, e se siano in grado di farlo senza compromettere il loro modello di business, rimane aperta.