Microsoft dichiara ufficialmente che Copilot serve solo a scopi di intrattenimento. I termini di servizio aggiornati avvertono gli utenti di non fidarsi dei risultati ottenuti.

Il dietrofront di Microsoft

L’ultimo aggiornamento dei termini d’uso di Copilot, datato 24 ottobre 2025, contiene un avviso sorprendente. Nonostante la spinta commerciale verso le aziende, il software viene declassato a semplice passatempo legale.

La clausola inserita dal colosso di Redmond parla chiaro. L’intelligenza artificiale non deve essere utilizzata per decisioni rilevanti.

Ecco i punti salienti del nuovo regolamento:

- Copilot è destinato esclusivamente a scopi di intrattenimento.

- Il sistema può commettere errori gravi in qualsiasi momento.

- Non è garantito il funzionamento previsto del modello.

- L’utente si assume ogni rischio derivante dall’utilizzo.

Rischi e responsabilità legale

La mossa sembra una strategia per evitare cause legali legate alle allucinazioni dell’IA. Microsoft scarica interamente la responsabilità sulle spalle dell’utilizzatore finale.

La frase “non affidatevi a Copilot per consigli importanti” crea un paradosso. L’azienda vende abbonamenti business per la produttività, ma ne nega l’affidabilità nei contratti.

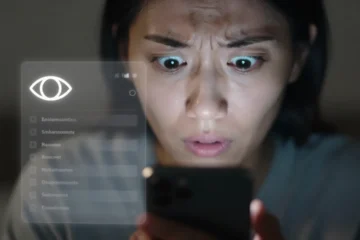

Molti utenti hanno condiviso sui social lo screenshot dei termini di utilizzo. La critica principale riguarda la discrepanza tra marketing e realtà legale.

L’avvertimento è perentorio: ogni output va verificato da un essere umano. Microsoft ammette implicitamente che la sua tecnologia non è ancora pronta per usi critici.

Il contrasto tra l’entusiasmo per l’IA e queste restrizioni è netto. Il termine “intrattenimento” riduce drasticamente l’autorità dello strumento nel settore professionale.